Embeddings en chatbots: entender el contenido sin ver los datos

¿Qué es un embedding?

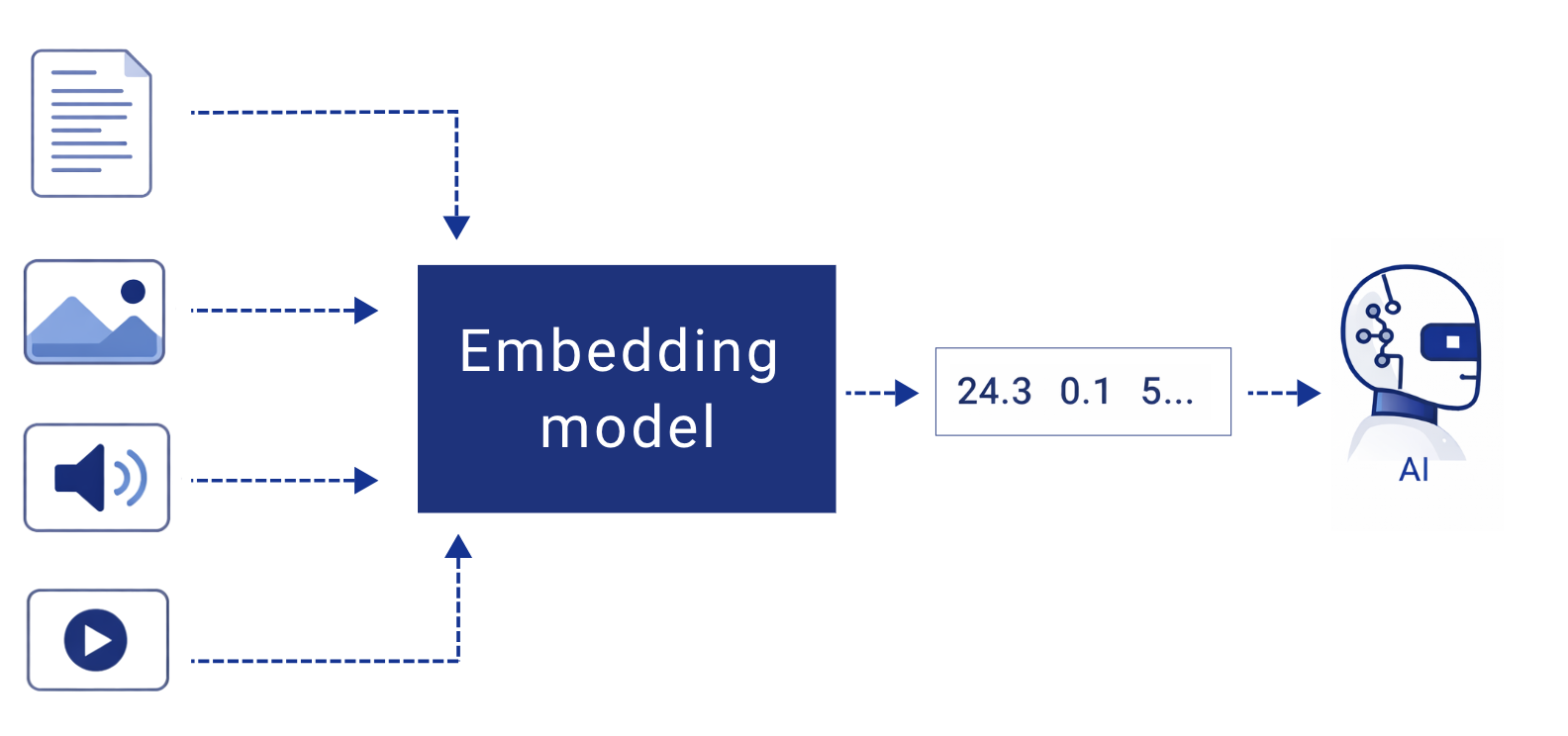

Un embedding es una forma de convertir información (texto, imágenes o audio) en números que representan su significado.

Así, la Inteligencia Artificial no trabaja con palabras o frases, sino con relaciones entre conceptos.

Imagina que tienes un documento confidencial.

En lugar de entregarlo tal cual, haces esto:

✗ No compartes el texto

✗ No compartes las palabras

✓ Solo compartes unas “coordenadas” que indican de qué trata

➡ Eso es un embedding.

Es una traducción del significado del texto a números.

La Inteligencia Artificial no ve el contenido original, solo una versión matemática que le permite saber:

• Si dos textos hablan de lo mismo

• Qué información está relacionada

• Qué fragmento es más relevante para responder

Es como decirle a alguien “esto va sobre facturación” sin enseñarle la factura.

¿Para qué sirven los embeddings?

Gracias a los embeddings, los sistemas pueden:

• Buscar información por significado, no por palabras exactas

• Comparar documentos y detectar similitudes

• Dar respuestas más precisas sin procesar textos completos

Esto hace que los modelos sean más eficientes y más controlables.

Embeddings y protección de datos

Conviene ser claros: los embeddings no garantizan por sí solos anonimato ni seguridad absoluta. Por eso, en Cloud Levante, los embeddings no se usan de forma aislada, sino como una capa más dentro de una estrategia global de seguridad, confidencialidad y privacidad de datos.

¿Por qué usamos embeddings en nuestros sistemas?

1. Menor exposición del dato original

El texto sensible no se envía directamente al modelo.

Primero se transforma en números que representan su significado.

2. El contenido no es legible

Acceder a un embedding no permite leer ni reconstruir fácilmente el texto original.

3. El modelo no se queda con tus datos

En arquitecturas basadas en RAG:

• Los datos permanecen en tus sistemas

• El modelo solo consulta fragmentos concretos en tiempo real

• No se usan para entrenar ni mejorar el modelo

4. Control y aislamiento

Los embeddings pueden:

• Vivir en infraestructuras controladas

• Tener accesos limitados

• Eliminarse o renovarse cuando sea necesario

5. Reducción del impacto ante incidentes

Frente a enviar documentos completos o entrenar modelos con datos sensibles, el riesgo y el impacto de una posible exposición se reduce de forma significativa.

Los embeddings no sustituyen a una estrategia de seguridad completa.

Pero, combinados con otras medidas de confidencialidad, privacidad y control del dato, permiten analizar información con modelos de lenguaje de forma mucho más segura.

En Cloud Levante, son solo una de las muchas capas que utilizamos para proteger los datos cuando diseñamos y entrenamos sistemas que trabajan con información real y sensible.